La verdadera revisión por pares nunca se ha intentado

En un mundo en el que la investigación puede circular rápidamente por Internet, tenemos que desarrollar nuevas formas de hacer ciencia en público.

[Traducción del artículo de Saloni Dattani para Works in progress]

Durante la mayor parte del siglo XX, la ciencia tuvo aspecto muy diferente al actual. Por un lado, no existía Internet. Si los investigadores querían compartir su trabajo con los demás, se reunían en persona -en conferencias y seminarios- o hacían circular su trabajo a través de la prensa escrita -en cartas, libros o revistas-.

Pero las revistas también funcionaban de forma muy diferente. Pocos estudios se sometían a la "revisión por pares", el procedimiento por el cual, después de que un científico presenta su artículo a una revista, el editor lo envía a otros científicos, que proporcionan comentarios y recomiendan si el artículo debe publicarse. Esta práctica no se convirtió en un requisito de la mayoría de las revistas hasta los años 70 y 80, décadas después de la Segunda Guerra Mundial.

Antes de la adopción de la revisión por pares, las revistas se centraban en la difusión rápida de cartas y comunicaciones entre científicos, con poca o ninguna edición o revisión externa. En 1953, cuando Watson y Crick quisieron dar a conocer ampliamente su descubrimiento de la estructura del ADN lo antes posible, enviaron su artículo a Nature especialmente porque la revista era conocida por su rapidez de publicación.

Como puedes deducir, la ausencia de revisión por pares también significaba que había diferentes normas para que las revistas decidieran qué publicar. Cuando los editores de las revistas confiaban en los científicos, tendían a publicar sus estudios sin cuestionarlos; cuando tenían dudas, enviaban sus trabajos a revisores externos de su confianza, pero aun así, eran principalmente los editores quienes decidían qué trabajos se publicaban.

La Royal Society fue probablemente la primera sociedad que introdujo la revisión por pares para sus revistas, aunque durante mucho tiempo fue en realidad un precursor de los tipos de revisión por pares que vemos hoy en día, en los que los artículos se envían a científicos que no están afiliados a la revista.

La revista Philosophical Transactions de la Royal Society había sido dirigida inicialmente de forma independiente por Henry Oldenburg, secretario de la sociedad desde 1665 hasta 1677. Oldenburg rara vez consultaba a los demás sobre los envíos que debía publicar y mantenía una separación entre las publicaciones de la revista y las actividades de la sociedad. Pero pocas personas ajenas a la sociedad eran conscientes de esta distinción y, en 1751, un botánico llamado John Hill publicó críticas y sátiras que desdibujaban la diferencia entre ambas y ridiculizaban la calidad de las investigaciones que publicaba la revista, especialmente durante el mandato de Oldenburg.

En respuesta a las burlas, la sociedad decidió que su consejo actuaría como revisor de los trabajos en Transactions, decidiendo qué envíos se publicaban y cuáles se rechazaban. A partir de 1752, se imprimieron anuncios en cada edición de la revista en los que se decía que las conclusiones o juicios realizados por los científicos en los estudios que publicaban no estaban avalados por la sociedad. Y en las décadas y siglos siguientes, el enfoque de la sociedad sobre las revisiones evolucionó, con varios pasos y devaneos en el camino. Durante un breve periodo de tiempo, en la década de 1830, se exigió a los revisores que llegaran a un consenso unánime sobre los trabajos que debían publicarse, hasta que esto resultó inviable. Poco después, los revisores se ampliaron para incluir a los miembros de la sociedad, no sólo al consejo.

A finales del siglo XX además de las revistas de la Royal Society, otras revistas empezaron a exigir la revisión por pares. Este cambio no se debió a que el concepto se propagara entre las revistas, sino a que los editores comenzaron a recibir muchos más envíos de los que podían publicar. La revisión por pares se convirtió en una cuestión de reputación para las revistas, por ejemplo, para evitar acusaciones de mala selección, como en la Royal Society, o de favoritismo, como en Nature.

En la década de 1970, el editor de Nature, David Davies, se dio cuenta de que -en contra de sus expectativas- la revista tenía una mala reputación fuera de Gran Bretaña. Los investigadores estadounidenses con los que habló creían que tenía un sesgo británico: que sus revisores vivían en Londres o Cambridge y tenían vínculos con los científicos que enviaban los trabajos. Cuando impuso la revisión por pares como requisito y reclutó nuevos revisores de otros países, fue para evitar conflictos de intereses y establecer Nature como una revista respetable en todo el mundo.

De una en una, las revistas adoptaron la revisión por pares como requisito para la publicación de las investigaciones científicas.

Las revistas, que hasta entonces se caracterizaban por ser plataformas rápidas de difusión de la investigación, cambiaron la velocidad por otras funciones. Ya no eran sólo difusoras de investigación, sino que intentaron respaldar su reputación filtrando qué investigaciones circulaban, mejorándolas y -basándose en su reputación- avalando su calidad.

El funcionamiento y la financiación de las revistas también han cambiado. Si bien la mayoría de las revistas habían sido gestionadas por sociedades académicas, muchas fueron adquiridas por editoriales comerciales a partir de la década de 1960.

En la actualidad, un puñado de grandes editoriales -Springer, Wiley-Blackwell, Taylor & Francis y RELX (antes conocida como Reed-Elsevier)- publican la mayoría de los artículos académicos de disciplinas completas, como las ciencias naturales, la medicina, las ciencias sociales y las humanidades.

***

Aunque la publicación académica se ha convertido en una industria comercial, algunos aspectos de las revistas siguen siendo iguales.

Los editores de las revistas siguen teniendo una gran influencia a la hora de decidir lo que se publica, ya que pueden buscar investigaciones en curso para solicitarlas y publicarlas y pueden rechazar por completo los envíos antes de enviarlos a la revisión por pares.

A diferencia de lo que ocurre con la publicación de libros y revistas, los científicos que publican en revistas no reciben remuneración por su trabajo. En cambio, los artículos académicos forman parte de la producción de investigación que las universidades y los financiadores de la investigación tienen en cuenta a la hora de asignar fondos y promociones. En el otro lado de la ecuación, las revistas se benefician de su reputación al filtrar, mejorar y avalar la calidad de los artículos que publican.

Las revistas dependen de las subvenciones y suscripciones de las bibliotecas institucionales, que pagan unos costes enormes y crecientes para acceder a los artículos. Las personas que no pertenecen a las grandes instituciones y que no están suscritas a las bibliotecas no tienen acceso a la investigación académica financiada con fondos públicos ni a los comentarios de los revisores de los artículos. Y a pesar de dedicar mucho tiempo a la revisión de artículos, los científicos que aceptan revisarlos siguen, salvo raras excepciones, sin ser remunerados ni reconocidos.

Hoy en día, los investigadores dedican gran parte de su tiempo y esfuerzo a revisar los artículos que se envían a las revistas. Se calcula que, sólo en 2020, los investigadores de todo el mundo dedicaron un total de 100 millones de horas a la revisión de artículos. Alrededor del 10% de los investigadores de economía dedican al menos 25 días laborables al año a la revisión.

Dado que nuestros sistemas de publicación científica se han quedado en el pasado, profundamente conectados a las revistas, esto conduce a un creciente cuello de botella y retraso.

Los artículos se acumulan en las bandejas de entrada de los correos electrónicos de los editores antes de ser compartidos con unos pocos revisores elegidos a dedo, que compaginan sus propias investigaciones y responsabilidades personales con la expectativa de revisar la investigación voluntariamente, metiéndola como pueden en el tiempo libre que tienen.

Los revisores varían mucho en cuanto a la cantidad de tiempo que pueden dedicar a la revisión de artículos, así como en cuanto a sus especialidades, etapas profesionales y la calidad de las revisiones que producen. Pero los directores de las revistas tienen poca idea de cuánto tiempo les queda libre y sólo pueden hacer un seguimiento de su calidad sobre la marcha, porque los investigadores realizan trabajos de revisión para muchas revistas diferentes, que trabajan por separado. Así que no es de extrañar que esta configuración sea un obstáculo para la publicación y una enorme carga para el tiempo de los investigadores.

Hoy en día, un científico que envía un estudio a Nature o PNAS, las Actas de la Academia Nacional de Ciencias, puede esperar que se publique nueve meses después, por término medio. En las principales revistas de economía, el proceso es aún más largo: la asombrosa cifra de 34 meses, es decir, casi tres años. Y la duración ha ido aumentando cada año.

Pero esto es sólo una parte del problema, porque el plazo es sólo para los trabajos que se aceptan. Cuando los investigadores ven rechazado su estudio por cualquier motivo, bueno o malo, pueden enviarlo a otras revistas en su lugar.

Sin embargo, la mayoría de las revistas exigen exclusividad: los investigadores sólo pueden enviar un trabajo a una revista a la vez. Por tanto, el proceso que dura meses hasta la publicación en la primera revista puede durar años, si el trabajo fue rechazado inicialmente, tras varias rondas de envío a diferentes revistas. Esto significa que incluso los buenos trabajos que acaban siendo publicados pueden quedar atrapados en el limbo durante años antes de que acaben viendo la luz.

Hasta cierto punto, estos problemas pueden ser abordados por las revistas, modificando la forma de identificar y recompensar a los revisores, así como la forma de presentar los artículos.

Por ejemplo, en algunas revistas, como American Economic Review, Journal of Political Economy y PeerJ, los revisores reciben pequeñas recompensas en metálico cuando envían una revisión a tiempo.

Investigadores han llevado a cabo experimentos para poner a prueba estos incentivos, y han descubierto que han sido eficaces.

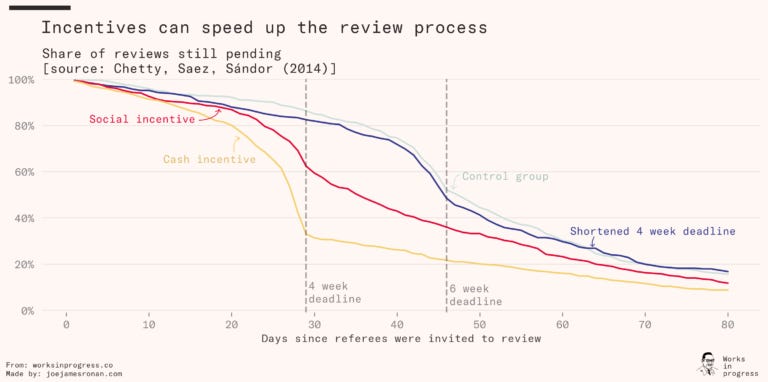

Por ejemplo, en un gran experimento realizado en 2014 en el Journal of Public Economics, un equipo dirigido por el economista Raj Chetty puso a prueba cuatro procesos de revisión: un control (con un plazo de seis semanas para que los revisores enviaran su revisión), un "empujón" de un plazo más corto (cuatro semanas), una recompensa en metálico de 100 dólares (por enviarlo en cuatro semanas) y un incentivo social (en el que se publicaban los tiempos que tardaban en revisar los envíos).

Los tres incentivos redujeron el tiempo que los revisores tardaron en presentar sus revisiones, siendo el incentivo en metálico por presentarlas en un plazo más corto el más eficaz. Ninguno de los incentivos tuvo un impacto en las medidas de calidad (la longitud de los informes de revisión o la decisión final del editor de publicar el artículo), a diferencia de los resultados de un experimento anterior a pequeña escala.

También hay otros enfoques que las revistas pueden utilizar para acelerar la revisión sin comprometer la calidad, por ejemplo, utilizando plataformas centralizadas para identificar a los investigadores con el tiempo y la especialidad para revisar los artículos.

Esto es importante porque la falta de tiempo o de experiencia son las dos principales razones que los investigadores citan para negarse a revisar la investigación y, como las revistas trabajan por separado para encontrar investigadores que revisen los artículos, la información relevante sobre los revisores está descentralizada.

El sitio web Publons aborda un problema relacionado al permitir a los investigadores anotar los artículos a los que ya han contribuido con revisiones, pero esto es diferente porque mantiene registros retrospectivos. En cambio, se podría imaginar una plataforma similar en la que los editores de las revistas pudieran hacer un seguimiento de la carga de trabajo actual, los intereses y las habilidades de los investigadores, para buscar a aquellos que tengan tiempo y experiencia relevante para revisar un artículo.

Por último, otros tipos de plataformas centralizadas podrían ser también muy importantes. En la actualidad, las revistas tienen acuerdos de exclusividad (lo que significa que los investigadores sólo pueden enviar artículos a una revista a la vez), pero también tienen diferentes requisitos de formato, que llevan mucho tiempo cumplir. Según las estimaciones de una encuesta, los artículos se envían una media de dos veces antes de ser publicados, y el formateo lleva un total de 14 horas por artículo.

Hay una analogía interesante en cómo los estudiantes presentan las solicitudes a las universidades en diferentes países. En EE.UU., los estudiantes tienden a presentar sus solicitudes a las universidades en grupos separados: la Solicitud Común, la Solicitud de la Coalición, la solicitud de la Universidad de California, las solicitudes para las pequeñas universidades individuales, las academias militares y un otras. Cada una de estas solicitudes tiene sus propias directrices y requisitos de redacción. Pero en el Reino Unido, los estudiantes tienden a hacer una sola solicitud a través de la plataforma centralizada, UCAS, que transfiere sus declaraciones personales a las universidades.

En una plataforma centralizada conectada a diferentes revistas, los científicos podrían presentar un artículo, ser emparejados con los revisores y seleccionar las revistas en las que quisieran publicarlo, pasando por el proceso de presentación y revisión una sola vez en lugar de una y otra vez.

Pero hay dos problemas que persisten con todas estas ideas.

El primero es que los comentarios y las decisiones de los revisores pueden ser muy variables incluso para el mismo artículo.

La calidad de las revisiones varía mucho: En las encuestas realizadas a investigadores de economía, los autores señalan que alrededor del 43% de las revisiones que reciben son de alta calidad, ya que les orientan para mejorar su análisis, comunicar mejor sus resultados y ponerlos en contexto; mientras que el 27% son de baja calidad, ya que son apresuradas, vagas, excesivamente exigentes o incluso insultantes a nivel personal.

Y las revisiones también varían mucho en sus conclusiones: cómo califican los artículos y si recomiendan a los editores que acepten o rechacen el artículo.

La mayoría de los artículos son revisados por una o tres personas, y el acuerdo entre ellas tiende a ser bajo. Los trabajos que reciben más desacuerdos tienden a considerarse menos creíbles, y se calcula que harían falta al menos cuatro o cinco revisores por trabajo para alcanzar una calificación media consistente. Pero teniendo en cuenta los retrasos y las demoras en la revisión de los artículos, duplicar el número de revisores por artículo para conseguirlo ralentizaría aún más el proceso.

El acuerdo entre revisores es aún menor en las fronteras de una disciplina, donde el consenso científico es menos claro. Pero tanto si se cree que este acuerdo es bueno como si es malo -quizá porque tener un grupo más diverso de revisores que no están de acuerdo entre sí ayuda a evitar sesgos y posiblemente a reconsiderar el consenso- hay un problema. Con sólo unos pocos revisores por artículo, las revisiones no son un signo de consenso ni de diversidad intelectual; más bien se acercan a un reflejo del azar.

Y hay otro límite a la eficacia de los esfuerzos realizados por las revistas: La revisión por pares es cada vez menos un guardián de la investigación que se comparte.

Hoy en día vivimos en un mundo muy diferente al que teníamos cuando las revistas circulaban en papel: Un mundo con Internet, donde los datos y la investigación no necesitan circular en publicaciones limitadas y caras. La investigación puede compartirse casi inmediatamente con redes masivas de científicos a través de blogs, preprints [1] , plataformas de almacenamiento de datos y foros en línea, con un coste mínimo o nulo.

En economía, la circulación de preprints ha sido normal durante décadas. En una situación en la que el artículo medio se publica tres años después de ser enviado a una revista, esto es indispensable. Pero el uso de preprints se ha disparado también en muchos otros campos, y no se está frenando.

En 2020 se publicaban más de 8.000 preprints al mes solo en el campo de las ciencias biomédicas. No se trata de borradores a medio escribir que no llegan a ninguna parte. La mayoría de los preprints en biología sí se publican -alrededor de tres cuartas partes aparecen en revistas en un plazo de ocho meses- y cuando se publican, suelen tener sólo pequeñas diferencias con respecto a sus versiones iniciales, algo que se mantuvo durante la pandemia de Covid-19.

La investigación no es la práctica de unos pocos investigadores que trabajan con unos pocos revisores durante meses o años antes de publicar un "producto final" de su trabajo - es un mundo en el que la ciencia puede ser compartida inmediatamente, corregida y mejorada por otros científicos a la vista del público.

Quizá no haya mejor ejemplo de ello que la forma en que se ha difundido la investigación durante la pandemia de Covid-19, que también ha puesto de manifiesto otras formas de compartir la investigación y otras formas de revisión por pares.

Cuando se compartió la primera secuencia del genoma del SARS-CoV-2 en enero de 2020, se hizo en virological.org, un foro online utilizado por virólogos. A continuación, hubo comentarios públicamente visibles que iban y venían entre los expertos, cuestionando y reanalizando los métodos utilizados para secuenciar esos genomas y las posibles implicaciones de sus hallazgos. Lo mismo ocurrió con las primeras secuencias del brote internacional de viruela del mono de 2022, en las que los aspectos inusuales de los genomas fueron discutidos por los expertos en los comentarios del foro, visibles para todo el mundo.

El trabajo de revisión también fue indispensable para los datos sobre el número de casos de Covid, hospitalizaciones, pruebas, vacunaciones y muertes en todo el mundo, que se almacenaron en GitHub. En esta plataforma para compartir código y crear software, decenas de usuarios de todo el mundo trabajaron entre bastidores y señalaron problemas en la recopilación de datos, definiciones y codificación de fuentes que procedían de muchos países.

Otro ejemplo es PubPeer, un sitio web lanzado en 2012 en el que los investigadores pueden crear hilos para comentar artículos ya publicados. Los científicos sociales tienden a utilizar la plataforma para debatir los defectos de los métodos de investigación y las conclusiones de los artículos. Sin embargo, la mayoría de los comentarios son realizados por investigadores de las ciencias de la salud y de la vida y sus comentarios tienden a relacionarse con la mala conducta científica, señalando la manipulación de imágenes en los artículos, los conflictos de intereses, el plagio y el fraude.

Esta página web es especialmente útil porque recopila los comentarios sobre mala conducta científica de muchos científicos, y se pueden buscar los comentarios relacionados con un artículo concreto. A menudo, las revistas han tardado meses o años en corregir los artículos publicados, incluso cuando han tenido manipulaciones y fallos flagrantes.

En 2020, PubPeer fue el sitio en el que la científica Elisabeth Bik señaló varias discrepancias y cuestiones en los estudios que afirmaban que la hidroxicloroquina era un tratamiento muy eficaz para el Covid-19; posteriormente se descubrió que el medicamento no tenía ningún beneficio contra la enfermedad. Bik dejó el mundo académico y trabajó en una empresa de biotecnología antes de decidir centrarse en la integridad de la imagen como consultora privada a tiempo completo.

Un último ejemplo es el uso de las redes sociales y la información periodística durante Covid-19. Aunque las redes sociales pueden amplificar la desinformación, también se han utilizado como plataforma para criticar los métodos de investigación deficientes y comentar los artículos publicados. En 2020, cuando los primeros estudios afirmaban que la tasa de mortalidad por infección de Covid-19 era inferior al 0,2%, los epidemiólogos y estadísticos señalaron los fallos y las anomalías de la investigación en blogs e hilos en Twitter, y los periodistas señalaron los conflictos de intereses de los autores en los medios de comunicación.

De estos ejemplos extraigo varios argumentos.

El primero es que no todas las investigaciones tienen que ajustarse al formato de un artículo académico para ser útiles al mundo. La investigación puede ser de gran calidad y al mismo tiempo ser muy incremental, formar parte de una serie de trabajos más amplios o realizarse con un proceso estandarizado (como la secuenciación de un genoma) que no requiere el típico formato de "resumen - introducción - métodos - resultados - discusión" utilizado en los artículos académicos.

Y las revisiones tampoco se limitan a un formato uniforme de comentarios en el texto: pueden implicar la comprobación del código de un análisis o de las imágenes de un artículo, el reanálisis de los datos o la elaboración de los resultados, siempre que los datos estén disponibles.

A partir de ahí, no es necesario que los revisores cubran todo, o incluso la mayor parte, de un estudio académico para que su aportación sea útil para la comunidad en general. Algunas personas son especialistas en aspectos concretos de la revisión, y los comentarios de diferentes personas con distintos conocimientos -epidemiología, estadística e incluso periodismo- pueden centrarse en diferentes aspectos de la investigación y seguir siendo valiosos, aportando una visión más amplia. Esto contrasta con las revisiones en las revistas académicas, en las que normalmente se espera que los revisores comenten todo el artículo, independientemente de sus propios dominios de experiencia, y la ausencia de comentarios en secciones de un artículo puede implicar que los revisores creen que están libres de errores.

What does this mean for the future of peer review?

¿Qué significa esto para el futuro de la revisión por pares?

El futuro de la revisión por pares podría significar que las revistas desafíen el típico proceso de revisión por pares, y algunas ya lo hacen.

La revista eLife sólo acepta trabajos que hayan sido publicados previamente como preprints, y hace público el contenido de sus revisiones por pares. PeerJ, como ya se ha mencionado, tiene recompensas por la revisión de los envíos, así como listas públicas de los manuscritos enviados que están a la espera de ser revisados, que otros investigadores pueden revisar voluntariamente. También dispone de un sistema de comentarios en sus artículos publicados, en el que los investigadores pueden hacer comentarios públicos sobre determinados párrafos y cifras de un artículo a los que otros pueden responder.

Otras revistas también han experimentado con nuevos modelos. La revista Atmospheric Chemistry and Physics utiliza una plataforma interactiva de revisión por pares, en la que los revisores y el público pueden comentar los envíos durante un plazo de seis semanas, antes de que los autores tengan que responder a los comentarios y hacer ajustes en sus artículos. Las revistas de F1000Research utilizan un sistema de revisión por pares posterior a la publicación, en el que los envíos se comparten inmediatamente, antes de ser revisados por los investigadores, y luego son calificados por el editor para indicar su aprobación.

Pero creo que el futuro pasa por pensar mucho más allá de las revistas.

Nos guste o no, la investigación se publica ya, fácilmente y cada vez más, fuera de las revistas, al igual que las revisiones. Por lo tanto, reformar la revisión por pares debería significar trabajar con la forma en que se comparte la ciencia en público, no ignorarla.

Parte de esto podría consistir en ir donde la gente ya está. Esto podría implicar herramientas como Altmetrics [2] , para agregar los comentarios y las críticas públicas de la investigación, de modo que otros investigadores y periodistas puedan poner fácilmente la investigación en contexto. O puede significar que plataformas de revisión centralizadas y foros como PubPeer se utilicen más ampliamente, para facilitar que la gente inicie hilos para comentar o criticar artículos en todas las plataformas. O una mayor adopción de herramientas como Statcheck para detectar errores estadísticos y la IA para detectar la duplicación y manipulación de imágenes en la investigación publicada.

Pero la revisión por pares es un proceso continuo, que no difiere del modo en que se crea la ciencia en general, donde la investigación se basa en trabajos anteriores, reforzando o criticando ideas y teorías.

Las revisiones son un tipo de producto de investigación muy valioso por derecho propio [3]. No sólo mejoran la investigación a la que se dirigen, sino que ponen la investigación en contexto para los periodistas, los responsables políticos, el público y otros investigadores. La revisión por pares no es sólo una práctica de las revistas para intentar proteger su reputación de las críticas. Es una parte sustancial de la práctica de la ciencia; la forma en que entendemos la investigación, en particular de los campos ajenos a nuestra propia experiencia.

Así pues, el futuro no consiste únicamente en utilizar nuevas herramientas y plataformas para la revisión por pares; se trata de que el mundo académico y la industria inviertan en ella al por mayor creando instituciones y equipos que la produzcan y hagan avanzar el proceso.

Pueden llevar a cabo varios aspectos de este trabajo, ya sea la revisión del código, la búsqueda de imágenes, el Red Teaming o los muchos otros aspectos del trabajo de revisión que se necesitan hoy en día y que podrían ser importantes en el futuro. Y pueden aprender de la práctica, de modo que puedan seguir creando nuevas herramientas y plataformas para automatizar partes rutinarias del trabajo de revisión para que se haga mejor y más rápido, realizar experimentos para entender qué prácticas funcionan mejor y propagarlas más.

Las posibilidades son amplias e imprevisibles porque las formas en que producimos la ciencia y la compartimos también están evolucionando. Las mejores herramientas e incentivos para revisar la ciencia están a la espera de ser descubiertas, creadas y adaptadas, y al invertir en nuevos equipos e instituciones, es el momento de preparar el terreno para construirlas.

Saloni Dattani es editora fundadora de Works in Progress y editora de Stripe Press. También es estudiante de doctorado, escritora científica e investigadora en Our World in Data. Puedes seguirla en Twitter aquí.